DeepSeek-V4 Preview — open-source модель с контекстом 1M токенов

DeepSeek официально запустил V4 Preview — следующее поколение своей флагманской модели, в двух версиях. Главное: 1 миллион токенов контекста, полностью открытые веса на Hugging Face и заявления о том, что Pro-версия играет в одной лиге с топовыми closed-source моделями мира.

Что сказал DeepSeek

DeepSeek-V4 Preview официально в релизе и с открытыми исходниками. Добро пожаловать в эпоху экономичного контекста в 1 миллион токенов.

DeepSeek-V4-Pro — 1,6 трлн параметров всего / 49 млрд активных. Производительность на уровне лучших закрытых моделей мира.

DeepSeek-V4-Flash — 284 млрд всего / 13 млрд активных. Ваш быстрый, эффективный и экономный выбор.

Пробуйте сейчас в chat.deepseek.com через Expert Mode / Instant Mode. API обновлён и доступен уже сегодня.

Две модели в одном релизе

DeepSeek придерживается архитектуры Mixture-of-Experts — не все параметры активируются на каждый запрос, только «эксперты» под конкретный вопрос. Это даёт огромные общие размеры при сравнительно скромной стоимости инференса.

- Параметров всего 1,6 трлн

- Активных 49 млрд

- Обучено на 33 трлн токенов

- Контекст 1 000 000 токенов

- Open source ✓ да

- API ✓ есть

- Режим Expert Mode

- Параметров всего 284 млрд

- Активных 13 млрд

- Обучено на 32 трлн токенов

- Контекст 1 000 000 токенов

- Open source ✓ да

- API ✓ есть

- Режим Instant Mode

Что DeepSeek говорит про V4-Pro

Усиленные агентные способности: open-source state-of-the-art (SOTA) в бенчмарках агентного кодирования.

Богатые знания о мире: опережает все текущие open-модели, уступая только Gemini-3.1-Pro.

Reasoning мирового класса: бьёт все текущие open-модели в математике / STEM / кодировании, соперничает с топовыми закрытыми.

Что про V4-Flash

Способности к reasoning — близко к уровню V4-Pro.

На простых агентных задачах работает наравне с V4-Pro.

Меньший размер модели, быстрее отвечает, и API стоит значительно дешевле.

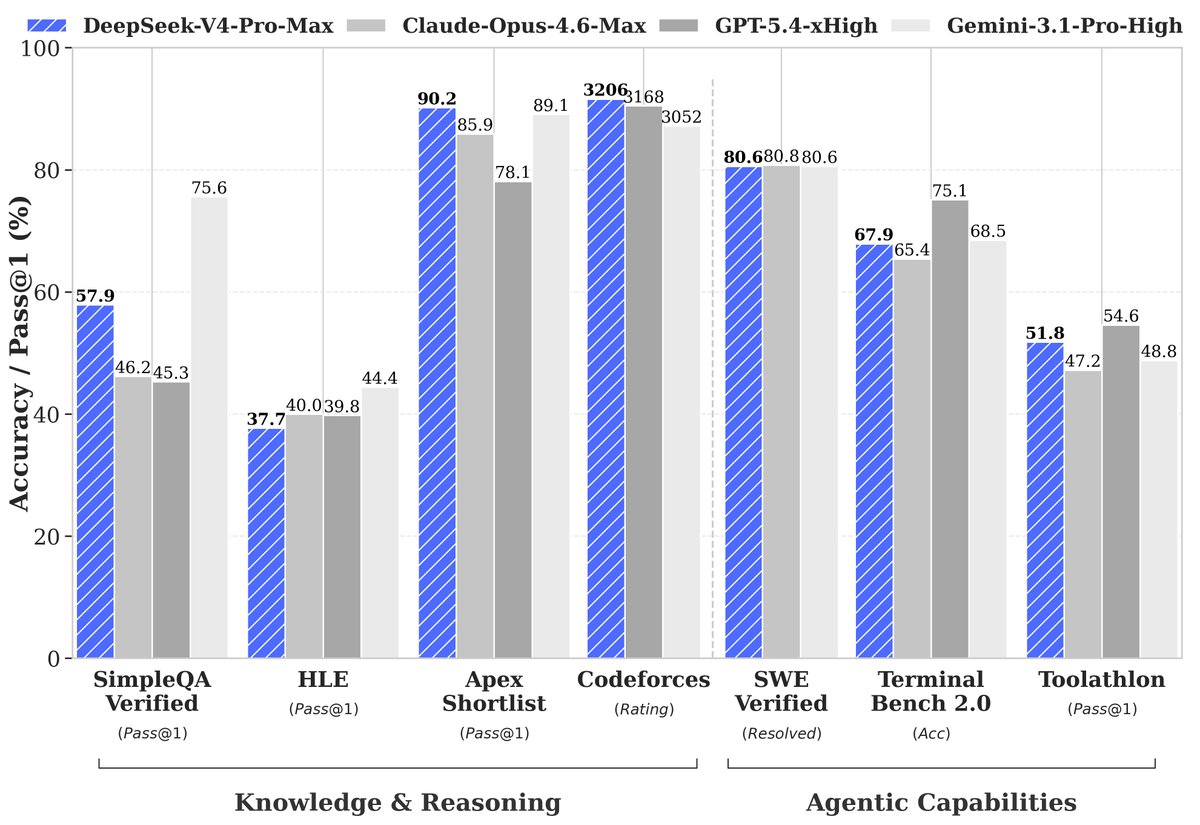

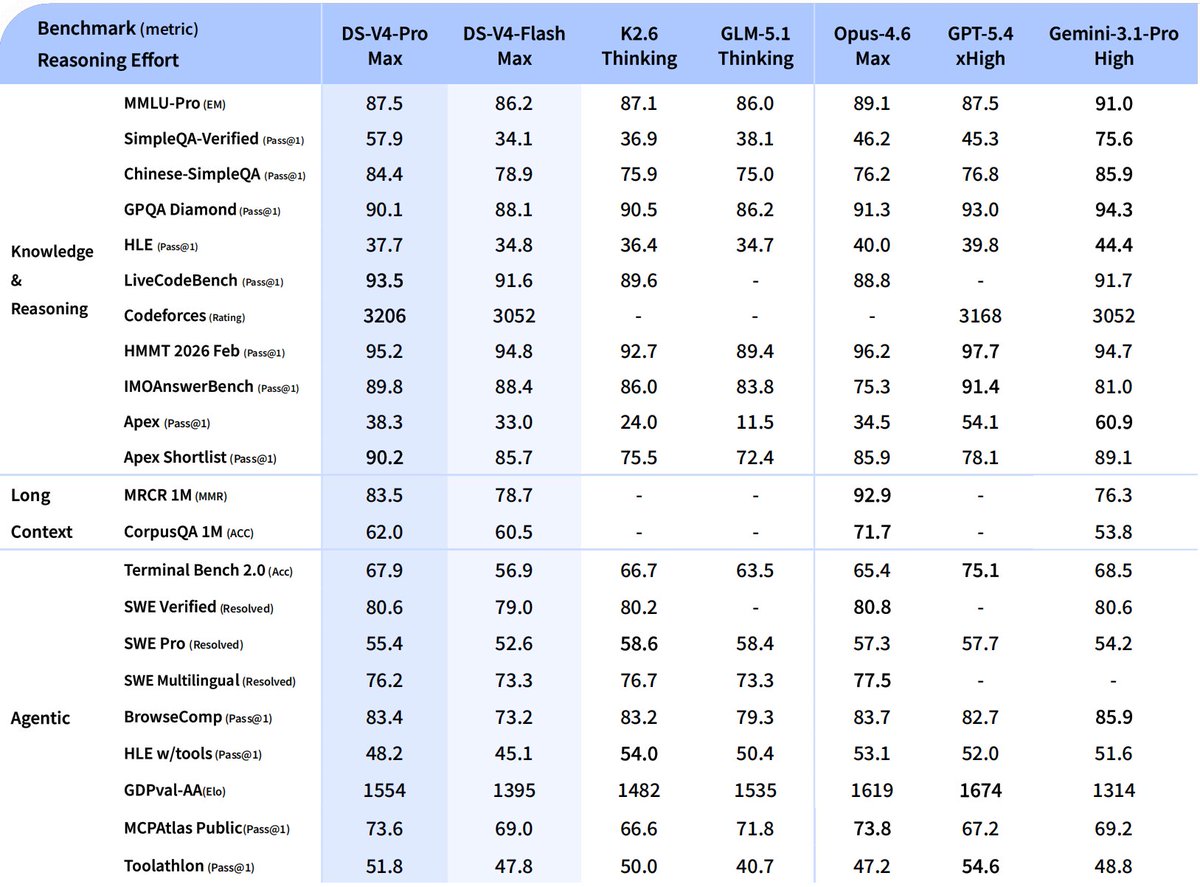

Бенчмарки — V4 vs конкуренты

DeepSeek опубликовал сводную таблицу сравнения: обе их модели против Kimi K2.6, GLM-5.1, Claude Opus-4.6, GPT-5.4 и Gemini-3.1-Pro. Цифры из официального треда, все прогоны на максимальном режиме.

| Метрика | DS-V4-Pro | DS-V4-Flash | K2.6 Think | GLM-5.1 Think | Opus-4.6 Max | GPT-5.4 xHigh | Gemini-3.1 Pro |

|---|---|---|---|---|---|---|---|

| Knowledge & Reasoning | |||||||

| MMLU-Pro | 87.5 | 86.2 | 87.1 | 86.0 | 89.1 | 87.5 | 91.0 |

| SimpleQA-Verified | 57.9 | 34.1 | 36.9 | 38.1 | 46.2 | 45.3 | 75.6 |

| Chinese-SimpleQA | 84.4 | 78.9 | 75.9 | 75.0 | 76.2 | 76.8 | 85.9 |

| GPQA Diamond | 90.1 | 88.1 | 90.5 | 86.2 | 91.3 | 93.0 | 94.3 |

| HLE | 37.7 | 34.8 | 36.4 | 34.7 | 40.0 | 39.8 | 44.4 |

| LiveCodeBench | 93.5 | 91.6 | 89.6 | — | 88.8 | — | 91.7 |

| Codeforces (rating) | 3206 | 3052 | — | — | — | 3168 | 3052 |

| HMMT 2026 Feb | 95.2 | 94.8 | 92.7 | 89.4 | 96.2 | 97.7 | 94.7 |

| IMO AnswerBench | 89.8 | 88.4 | 86.0 | 83.8 | 75.3 | 91.4 | 81.0 |

| Apex | 38.3 | 33.0 | 24.0 | 11.5 | 34.5 | 54.1 | 60.9 |

| Apex Shortlist | 90.2 | 85.7 | 75.5 | 72.4 | 85.9 | 78.1 | 89.1 |

| Long Context | |||||||

| MRCR 1M | 83.5 | 78.7 | — | — | 92.9 | — | 76.3 |

| CorpusQA 1M | 62.0 | 60.5 | — | — | 71.7 | — | 53.8 |

| Agentic | |||||||

| Terminal Bench 2.0 | 67.9 | 56.9 | 66.7 | 63.5 | 65.4 | 75.1 | 68.5 |

| SWE Verified | 80.6 | 79.0 | 80.2 | — | 80.8 | — | 80.6 |

| SWE Pro | 55.4 | 52.6 | 58.6 | 58.4 | 57.3 | 57.7 | 54.2 |

| SWE Multilingual | 76.2 | 73.3 | 76.7 | 73.3 | 77.5 | — | — |

| BrowseComp | 83.4 | 73.2 | 83.2 | 79.3 | 83.7 | 82.7 | 85.9 |

| HLE w/tools | 48.2 | 45.1 | 54.0 | 50.4 | 53.1 | 52.0 | 51.6 |

| GDPval-AA (Elo) | 1554 | 1395 | 1482 | 1535 | 1619 | 1674 | 1314 |

| MCPAtlas Public | 73.6 | 69.0 | 66.6 | 71.8 | 73.8 | 67.2 | 69.2 |

| Toolathlon | 51.8 | 47.8 | 50.0 | 40.7 | 47.2 | 54.6 | 48.8 |

В одиннадцати метриках из двадцати двух V4-Pro — лучший или вровень с лучшим. Особенно выделяется reasoning на Chinese-SimpleQA (SOTA), SWE Verified (топ-3 в мире вместе с Gemini и Opus), IMO AnswerBench. V4-Flash у большинства метрик держится в 2–5 пунктов от Pro, при этом в 6 раз меньше активных параметров.

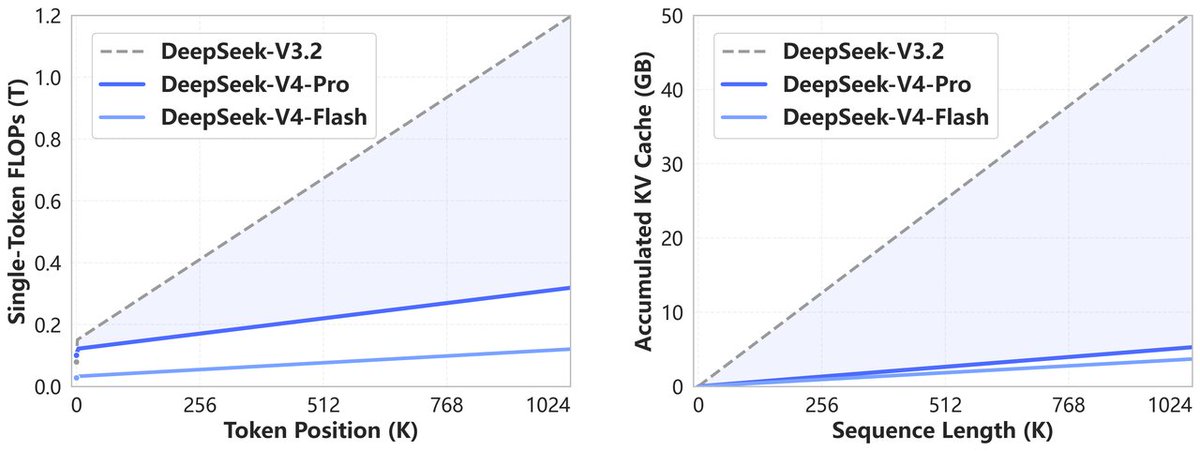

Как они это сделали — структурная инновация

Из закреплённого твита про архитектуру (фрагмент 4/n треда):

Novel Attention — token-wise компрессия + DSA (DeepSeek Sparse Attention).

Peak Efficiency — длинный контекст мирового уровня при резко сниженных затратах на вычисления и память.

1M Standard — один миллион токенов контекста теперь является значением по умолчанию.

DSA (DeepSeek Sparse Attention) — собственная технология компании, снижает затраты на inference при длинном контексте. Именно за счёт этой архитектуры 1M контекст становится «экономичным», а не просто «возможным».

Оптимизация под агентные задачи

Из 5/n твита треда — прямая цитата:

DeepSeek-V4 бесшовно интегрируется с ведущими AI-агентами — Claude Code, OpenClaw и OpenCode.

Уже используется внутри DeepSeek для собственной agentic-разработки.

Важный момент для нас: упоминание Claude Code в списке «с чем мы интегрированы из коробки» — это сигнал, что модель рассчитана на те же паттерны использования, что и флагманские closed-source — tool calls, длинные цепочки действий, понимание контекста проекта.

API совместим с OpenAI и Anthropic

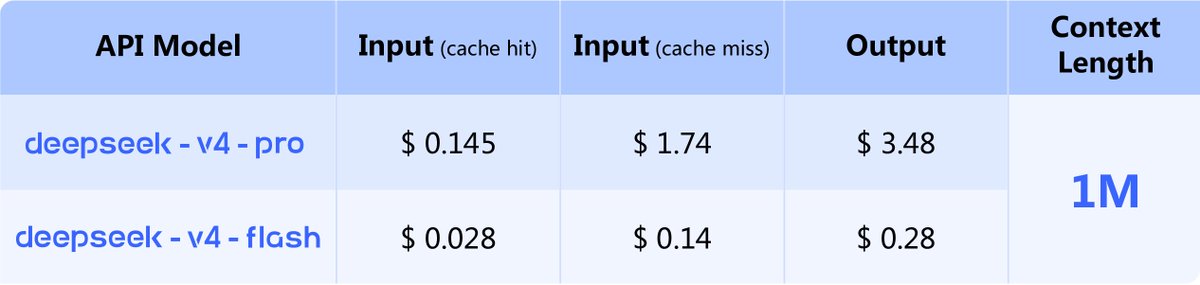

Из 6/n твита треда — самая практичная часть всей новости:

Оставляете base_url без изменений, просто меняете модель на

deepseek-v4-pro

или

deepseek-v4-flash.

Поддерживаются схемы API: OpenAI ChatCompletions и Anthropic.

Обе модели поддерживают контекст 1M токенов и два режима — Thinking / Non-Thinking.

Для нашего кода в MBK-Agent это значит следующее: поскольку наши AI-агенты уже

работают через OpenAI-совместимый клиент (streaming, tool calls, длинный контекст),

переключение на DeepSeek-V4-Flash — это замена одной строки

в конфигурации: model="gpt-5.4-mini"

→ model="deepseek-v4-flash".

Остальной код не меняется. Это качественно отличается от истории с GPT-5.5, где

модель доступна только через OpenAI API — в случае DeepSeek можно даже запустить

веса on-premise на своём железе (см. §05).

Почему 1M контекста — это важно

До сих пор большой контекст был привилегией флагманов OpenAI и Anthropic, и за это надо было платить — как деньгами за токены, так и скоростью инференса. DeepSeek заявляет экономичный 1M контекст. Если цифры сойдутся — это меняет экономику длинных AI-сценариев.

Что это даёт в нашем сценарии — AI-агенты для отдела продаж:

- Вся история клиента в одном контексте. Вместо того чтобы выдёргивать куски из CRM и склеивать в промпт, можно скормить агенту всю воронку по клиенту целиком.

- Долгие диалоги без потери памяти. Агент помнит каждый шаг разговора и решения клиента — не надо городить векторные базы для «долгой памяти».

- Полная база знаний в промпте. Документы компании, скрипты, FAQ, описание продуктов — всё вместе, а не через RAG с риском упустить нужный фрагмент.

Почему open-source меняет расклад

Веса выложены на Hugging Face, технический отчёт доступен публично. Это означает:

- Можно развернуть у себя на серверах — никакого внешнего API, полный контроль над данными. Критично для 152-ФЗ и клиентов с особыми требованиями к security.

- Стоимость инференса определяется вашим железом — при больших объёмах диалогов это может быть значимо дешевле коммерческих API.

- Нет зависимости от санкций / смены тарифов — модель у нас внутри периметра, никто не выдернет доступ.

Что мы планируем сделать

-

Тест V4-Flash через API Бенчмарк на наших SERP-кластерах и задачах рерайта FAQ — так же, как мы тестировали Kimi, Grok и GPT-5.4-mini. Cравним по цене/качеству/скорости.в очереди

-

Пилотное развёртывание V4-Flash on-premise Для клиентов, которые требуют 152-ФЗ развёртывания внутри контура — V4-Flash с 13B активных параметров может помещаться на разумное железо. Проверим.планируется

-

Эксперимент с 1M контекста Сценарий «AI-агент с полной историей клиента + всей базой продукта в контексте» — без RAG. Сравним качество ответов с текущим RAG-подходом на GPT-5.4-mini.исследование

Сроки и план миграции

Параллельно с тестированием GPT-5.5 запустим прогон DeepSeek-V4-Flash — 1–2 недели на замеры. Если по «цена × качество × скорость» выйдет лучше — добавим как опцию в клиентские проекты. Особенно интересно посмотреть ситуации, где нужен on-premise — тут V4-Flash может оказаться единственным реалистичным вариантом.